La Ricerca Google è in grado di comprendere il linguaggio umano con l’assistenza di più modelli di intelligenza artificiale che lavorano tutti insieme per trovare i risultati più rilevanti.

Le informazioni su come funzionano questi modelli di intelligenza artificiale sono spiegate in termini semplici da Pandu Nayak, vicepresidente della ricerca di Google, in un nuovo articolo sul blog ufficiale dell’azienda.

Nayak demistifica i seguenti modelli di intelligenza artificiale, che svolgono un ruolo importante nel modo in cui Google restituisce i risultati di ricerca:

- RankBrain

- Corrispondenza neurale

- BERT

- MAMMA

Nessuno di questi modelli funziona da solo. Tutti si aiutano a vicenda eseguendo diverse attività per comprendere le query e abbinarle ai ricercatori di contenuti che stanno cercando.

Ecco i punti chiave dello sguardo dietro le quinte di Google su cosa fanno i suoi modelli di intelligenza artificiale e come tutto si traduce in risultati migliori per i ricercatori.

Spiegazione dei modelli AI di Google

RankBrain

Il primo sistema di intelligenza artificiale di Google, RankBrain, è stato lanciato nel 2015.

Come suggerisce il nome, lo scopo di RankBrain è capire l’ordine migliore per i risultati di ricerca classificandoli in base alla pertinenza.

Nonostante sia il primo modello di deep learning di Google, RankBrain continua a svolgere un ruolo importante nei risultati di ricerca oggi.

RankBrain aiuta Google a capire in che modo le parole in una query di ricerca si riferiscono a concetti del mondo reale.

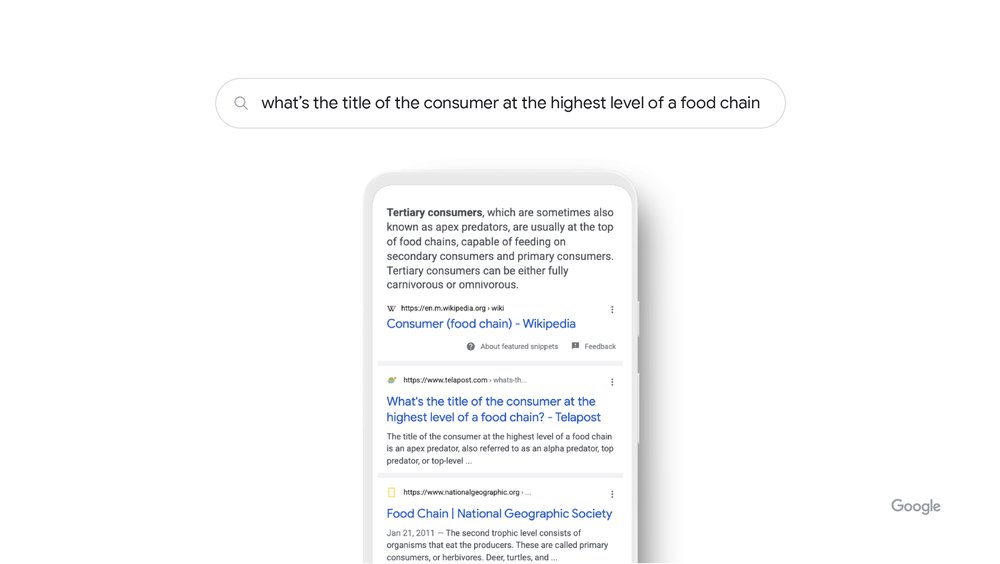

Nayak illustra come funziona RankBrain:

“Ad esempio, se cerchi “qual è il titolo del consumatore al livello più alto di una catena alimentare”, i nostri sistemi imparano vedendo su varie pagine quelle parole che il concetto di catena alimentare può avere a che fare con gli animali, e non consumatori umani.

Comprendendo e abbinando queste parole ai loro concetti correlati, RankBrain capisce che stai cercando ciò che viene comunemente definito un predatore apicale.”

Leggi anche: SERP: Cos’è e Perché è Importante per la SEO

Corrispondenza neurale

Google ha introdotto la corrispondenza neurale nei risultati di ricerca nel 2018.

La corrispondenza neurale consente a Google di capire in che modo le query si riferiscono alle pagine utilizzando la conoscenza dei concetti più ampi.

Piuttosto che guardare le singole parole chiave, la corrispondenza neurale esamina intere query e pagine per identificare i concetti che rappresentano.

Con questo modello di intelligenza artificiale, Google è in grado di creare una rete più ampia quando eseguiamo la scansione del suo indice per i contenuti rilevanti di una query.

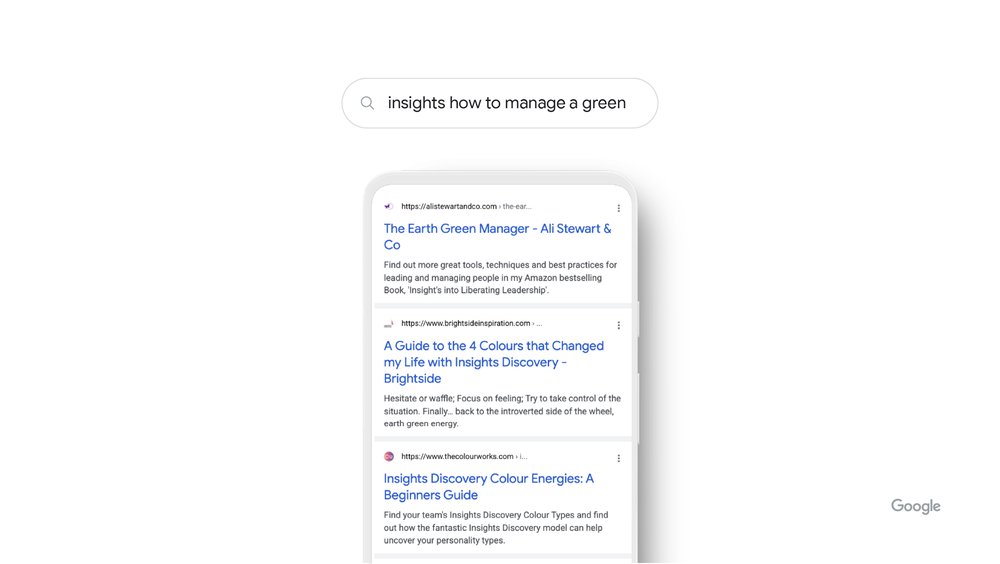

Nayak illustra come funziona la corrispondenza neurale:

“Prendete la ricerca “approfondimenti su come gestire un verde”, per esempio.

Se un amico te lo chiedesse, probabilmente saresti perplesso.

Ma con l’abbinamento neurale, siamo in grado di dargli un senso.

Osservando le più ampie rappresentazioni dei concetti nella query – gestione, leadership, personalità e altro – la corrispondenza neurale può decifrare che questo utente sta cercando: suggerimenti per la gestione basata su una popolare guida della personalità basata sul colore.”

BERT

BERT è stato introdotto per la prima volta nel 2019 e ora è utilizzato in tutte le query.

È progettato per ottenere due risultati: recuperare contenuti pertinenti e classificarli.

BERT è in grado di capire come le parole si relazionano tra loro quando vengono utilizzate in una sequenza particolare, il che garantisce che le parole importanti non vengano lasciate fuori da una query.

Questa complessa comprensione del linguaggio consente a BERT di classificare i contenuti Web per rilevanza più velocemente rispetto ad altri modelli di intelligenza artificiale.

Nayak illustra come funziona in pratica BERT:

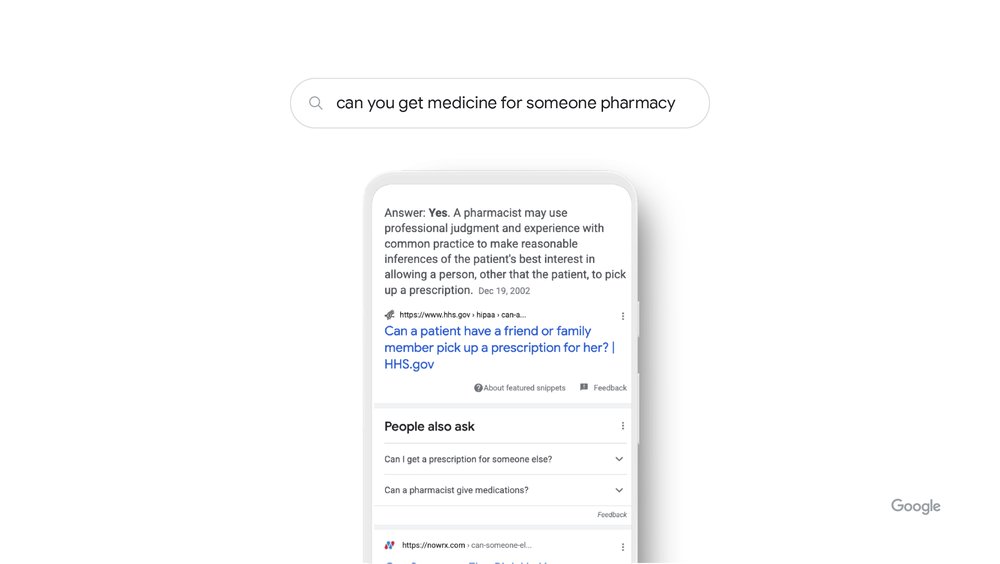

“Ad esempio, se cerchi “puoi prendere medicine per qualcuno in farmacia”, BERT capisce che stai cercando di capire se puoi prendere medicine per qualcun altro.

Prima di BERT, davamo per scontata quella breve preposizione, condividendo principalmente i risultati su come compilare una prescrizione.

Grazie a BERT, capiamo che anche le parole piccole possono avere grandi significati.”

MUM

L’ultima pietra miliare dell’IA di Google nella ricerca: Multitask Unified Model, o MUM, è stata introdotta nel 2021.

MUM è mille volte più potente di BERT e capace sia di comprendere che di generare linguaggio.

Ha una comprensione più completa delle informazioni e della conoscenza del mondo, essendo addestrato in 75 lingue e molti compiti diversi contemporaneamente.

La comprensione del linguaggio da parte di MUM abbraccia immagini, testo e altro in futuro. Ecco cosa significa quando senti che MUM viene chiamata “multimodale”.

Google è agli inizi della realizzazione del potenziale di MUM, quindi il suo utilizzo nella ricerca è limitato.

Attualmente, MUM viene utilizzato per migliorare le ricerche di informazioni sul vaccino COVID-19. Nei prossimi mesi verrà utilizzato in Google Lens come metodo di ricerca utilizzando una combinazione di testo e immagini.

Riepilogo

Ecco un riepilogo di quali sono i principali sistemi di intelligenza artificiale di Google e cosa fanno:

- RankBrain: classifica i contenuti comprendendo come le parole chiave si relazionano ai concetti del mondo reale.

- Corrispondenza neurale: offre a Google una comprensione più ampia dei concetti, che espande la quantità di contenuti che Google è in grado di cercare.

- BERT: consente a Google di capire come le parole possono cambiare il significato delle query se utilizzate in una sequenza particolare.

- MUM: comprende le informazioni e la conoscenza del mondo in dozzine di lingue e modalità multiple, come testo e immagini.

Questi sistemi di intelligenza artificiale lavorano tutti insieme per trovare e classificare i contenuti più rilevanti per una query il più velocemente possibile.

Fonte: Google